879

Bạn có biết những cỗ máy tìm kiếm như google hay bing hoạt động như thế nào, một phần SE sẽ sử dụng file robots.txt trên website để thực hiện quét dữ liệu và lập chỉ mục và dưới đây là một số thông tin để bạn hiểu rõ hơn về file robots.txt

File robots.txt là gì?

File robots.txt là một tập tin văn bản đơn giản có dạng .txt. Tệp này là một phần của Robots Exclusion Protocol (REP) chứa một nhóm các tiêu chuẩn Web quy định cách Robot Web (hoặc Robot của các công cụ tìm kiếm) thu thập dữ liệu trên web, truy cập, index nội dung và cung cấp nội dung đó cho người dùng.

REP cũng bao gồm các lệnh như Meta Robots, Page-Subdirectory, Site-Wide Instructions. Nó hướng dẫn các công cụ của Google xử lí các liên kết. (ví dụ: Follow hay Nofollow link).

Hiểu đơn giản robots.txt là một tệp ở gốc trang web của bạn cho biết những phần thuộc trang web bạn không muốn cấp quyền truy cập cho trình thu thập dữ liệu của công cụ tìm kiếm. Đây là file đầu tiên mà Google Bot sẽ đọc khi truy cập Website của bạn.

File robots.txt bao gồm giao thức là một tệp nhỏ các lệnh để quy định cho các cỗ máy tìm kiếm dữ liệu được phép hoặc không được phép thu thập dữ liệu trong website của bạn.

File robots.txt để làm gì?

Cho phép hoặc hạn chế Google Bot (hay các công cụ thu thập dữ liệu khác như Cốc Cốc Bot, Bing bot, Ahrefs…) được phép lập chỉ mục, thu thập dữ liệu Website của bạn. Robots.txt được sử dụng để kiểm soát lưu lượng truy cập của Bot, hạn chế các trang kém chất lượng, ẩn website khỏi công cụ tìm kiếm…

Các tệp lệnh nhỏ trong file robots.txt bạn cần biết

File robots.txt được nằm ở thư mục gốc của Website. Để kiểm tra website của bạn có file robots.txt hay chưa bạn chỉ cần thêm /robots.txt vào sau tên miền của bạn. Nếu có thể truy cập được thì Website đã có robots.txt. Nếu Website chưa có thì bạn chỉ cần tạo file này trên máy tính và gửi cho người code trang web.

VD: https://cmbliss.com/robots.txt

- Ngăn chặn nội dung trùng lặp (Duplicate Content) xuất hiện trong website (lưu ý rằng các Robot Meta thường là lựa chọn tốt hơn cho việc này)

- Giữ một số phần của trang ở chế độ riêng tư

- Giữ các trang kết quả tìm kiếm nội bộ không hiển thị trên SERP

- Chỉ định vị trí của Sitemap

- Ngăn các công cụ của Google Index một số tệp nhất định trên trang web của bạn (hình ảnh, PDF, …)

- Dùng lệnh Crawl-delay để cài đặt thời gian. Điều này sẽ ngăn việc máy chủ của bạn bị quá tải khi các trình thu thập dữ liệu tải nhiều nội dung cùng một lúc.

Cú pháp của file robots.txt

Các cú pháp được xem là ngôn ngữ riêng của các tập tin robots.txt. Có 5 thuật ngữ phổ biến mà bạn sẽ bắt gặp trong một file robots.txt. Chúng bao gồm:

- User-agent: Tên loại bot

- Allow: Cho phép

- Disallow: Không cho phép

- Sitemap: Đường dẫn sơ đồ của trang web.

- Crawl-delay: Thông báo cho các Web Crawler biết rằng nó phải đợi bao nhiêu giây trước khi tải và thu thập nội dung của trang. Tuy nhiên, lưu ý rằng bọ tìm kiếm Googlebot không thừa nhận lệnh này. Bạn cài đặt tốc độ thu thập dữ liệu trong Google Search Console.

Pattern – Matching

Tất cả các công cụ của Google và Bing cho phép sử dụng 2 biểu thức chính để xác định các trang hoặc thư mục con mà SEO muốn loại trừ. Hai kí tự này là dấu hoa thị (*) và ký hiệu đô la ($).

* là kí tự đại diện cho bất kì chuỗi kí tự nào – Có nghĩa là nó được áp dụng cho mọi loại Bots của các công cụ Google.

$ là kí tự khớp với phần cuối của URL.

Sử dụng file robots.txt

- Cấu trúc của 1 file robots.txt chuẩn bao gồm

User-agent: *

Allow: /

Disallow: /tim-kiem/

Sitemap: https://domain.com/sitemap.xml- Sử dụng file robots.txt để chặn Google (trong quá trình webiste đang xây dựng)

Trong quá trình bạn đang hoàn thiện website, cụ thể là website trong giai đoạn demo, chưa có nội dung, chưa tối ưu nội dung, hình ảnh, cấu trúc… thì bạn nên chặn Google lập chỉ mục trong thời gian này.

Cấu trúc file robots.txt

User-agent: *

Disallow: /- Sử dụng file robots.txt để quy định nội dung nào được lập chỉ mục, nội dung nào không được lập chỉ mục.

VD: Có 1 website là domain.com và có 2 danh mục Apple (domain.com/apple) và Samsung (domain.com/samsung) Chúng ta sẽ thực hiện chặn mục samsung thì các bạn thực hiện như sau

User-agent: *

Disallow: /samsung- Sử dụng robot.txt để chặn những trang kém chất lượng, nội dung tự tạo

Phổ biến nhất là trang tìm kiếm trên mỗi Website. Trang này có nội dung kém chất lượng và bất kỳ ai đều có tự tạo nội dung ở đây. Bất kỳ từ khóa nào người dùng tìm kiếm khi gõ vào ô tìm kiếm đều được hiển thị trên Website của bạn. Vậy sẽ ra sao nếu đối thủ họ đưa các từ khóa nhạy cảm, từ khóa cấm vào website của bạn và họ xây dựng các backlink về những liên kết đó?

Phần tìm kiếm là trang mà bạn nên chặn, mỗi một trang web có url của phần tìm kiếm khác nhau

Ví dụ một vài trang web thường để là domain.com/?seach= bởi vậy code sẽ như sau

User-agent: *

Disallow: /?seach=- Sử dụng để chặn google index và lộ link các file download trả phí

Một số các trang web có tải lên các file pdf để người dùng tải về, thông thường các file này rất nặng sẽ gây tốn tài nguyên cho Website. Hoặc một số Website cho phép tải file trả phí nhưng ko dấu đường link download cũng có thể Google sẽ index các nội dung này. Tốt nhất là không tải file nào nặng lên Website (hacker có thể tấn công website sẽ rất nhanh bị sập). Hoặc bạn có thể chặn theo cách sau để hạn chế

User-agent: *

Disallow: *.pdfcác file khác các bạn làm tương tự thông qua đuôi file

- Sử dụng để chặn các công cụ thu thập liên kết (như Ahrefs)

Để đảm bảo an toàn cho các website vệ tinh tránh việc đối thủ nhòm ngó và biết được hệ thống của bạn, bạn nên chặn tất cả các công cụ quét liên kết (đặc biệt là ahrefs.com – công cụ check backlink lớn nhất hiện tại).

Lưu ý: Robots.txt không chặn dược các liên kết (link) tham chiếu tới Website của bạn. Để chặn ahrefs bạn cần đặt file robots.txt này trên các website vệ tinh.

Bài viết liên quan

Vòng quay may mắn

Tạo vòng quay may mắn miễn phí, dựa trên nhu cầu thực tiễn nhiều người muốn sử dụng vòng quay để tổ chức các trò

Công cụ hỗ trợ và phát triển số

Trong thời đại chuyển đổi số mạnh mẽ, công cụ hỗ trợ và phát triển số đã trở thành những “trợ thủ đắc lực”

Website nào phải đăng ký với Bộ Công thương?

Việc thành lập website khi hoạt động doanh nghiệp ngày càng trở nên phổ biến. Vậy những website nào của tổ chức, cá nhân

Nghị định 15/2022/NĐ-CP giảm thuế giá trị gia tăng xuống 8% từ ngày 01/02/2022

Nghị định 15/2022/NĐ-CP ngày 28/01/2022 quy định chính sách miễn, giảm thuế theo Nghị quyết 43/2022/QH15, trong đó có hướng

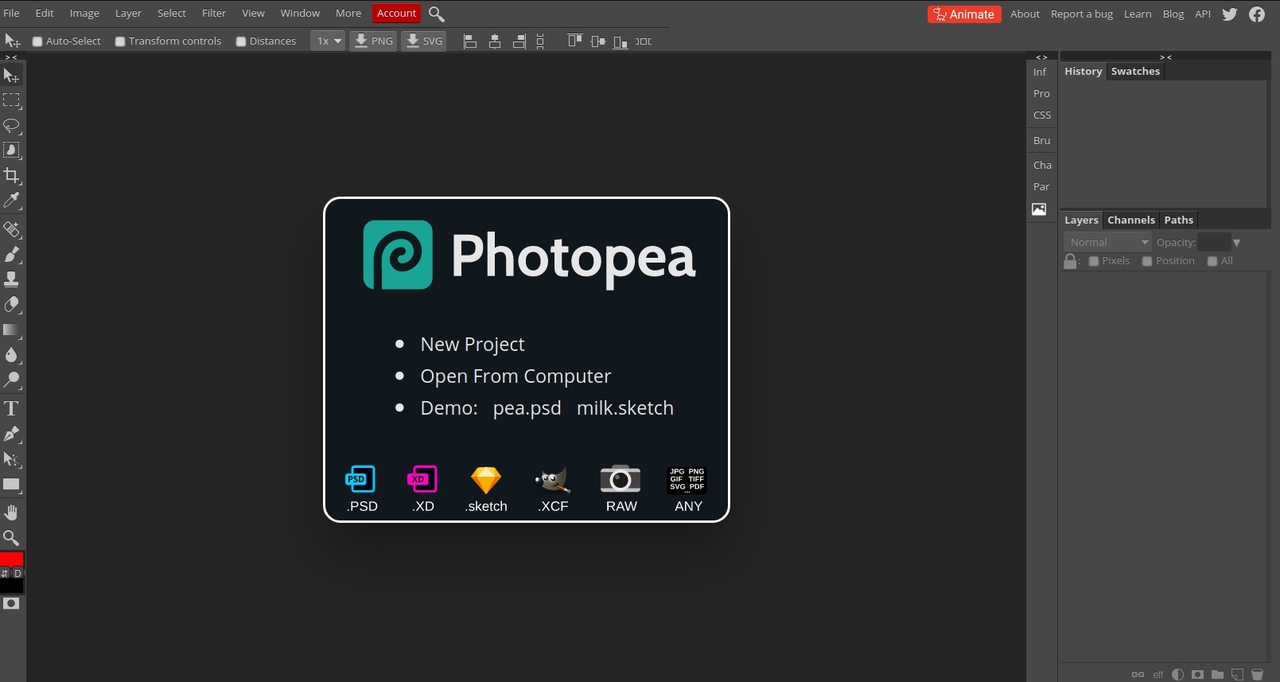

Photoshop Online, ghép ảnh trực tuyến, chỉnh sửa ảnh online, Photopea chỉnh sửa ảnh

Gọi Photopea.com là công cụ Photoshop online không quá đáng chút nào. Tất nhiên, nó không có đầy đủ tính năng chỉnh sửa ảnh

Thiết kế website có chịu thuế GTGT không?

Thiết kế website có chịu thuế gtgt không là một trong những câu hỏi được nhiều khách hàng thắc mắc. Để những khách

Cài đặt xác minh email trên hosting cPanel để gửi mail không bị vào spam

Cài đặt lỗi gửi email vào spam khi gửi mail từ hosting cPanel. Khi sử dụng mail từ domain để gửi cho khách hàng thường thì

File Sitemap.xml là gì?

Sitemap (sitemaps) có nghĩa là sơ đồ trang trong Website thì sitemap là sơ đồ website của bạn, hiện nay nhiều bạn quản trị website

Công cụ giúp quản trị website hiệu quả

Bạn là một người quản trị website và bạn sẽ phải làm gì để việc quản lý trở lên hiệu quả cho công việc, hiện nay

Các bước thiết kế website cho khách hàng

Bạn là một người đang có nhu cầu thiết kế web mà không biết phải bắt đầu từ đâu, làm thế nào để tối ưu thời